拡張現実:UXに対してどんな意味があるのか

AR技術は、インタラクションコストや認知負荷、視線の切り替えの回数を減らすことによって、ユーザーエクスペリエンスにインパクトを与えることができる。

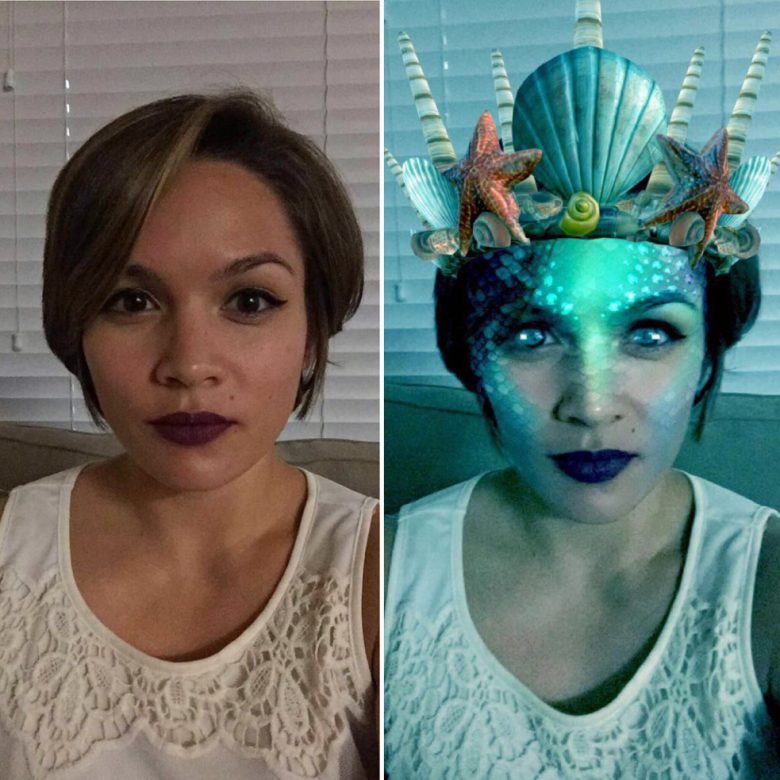

Pokemon GOやSnapChatのような人気アプリのおかげで、「拡張現実」という言葉が注目を浴びてきている。2016年の7月、Pokemon GO(および、人気の拡張現実ゲーム・Ingress)の開発会社であるNianticは、1日あたりの収益がPokemon GO単独で1000万ドルあることを発表し、拡張現実という機能が主流市場でも成功できることを証明した。しかし、このように拡張現実への関心に新たに火がついたことで、この用語はさまざまなテクノロジーに気前よく使われるようになってしまった。中には、観客の前で実施されたMichael Jacksonのパフォーマンスのホログラム映像のように、拡張現実の条件を満たしているとは言い切れないものもある。

定義:拡張現実(AR)とは、実際に存在している世界からのリアルタイムな入力を取り込み、現実世界のデータと、それらの現実世界からの入力で動作するようプログラムされたインタラクティブな要素の両方を組み合わせた出力を作成する技術を指します。

そのテクノロジーが「拡張現実」と見なされるためには、以下の条件を満たしていなければならない:

- 新しい外部情報に対してコンテキストにもとづいた反応をするので、ユーザーの環境の変化に対する説明がつく

- リアルタイムでジェスチャーや行動を解釈し、ユーザーからの明示的なコマンドは必要ないか、最低限ですむ

- ユーザーの環境内で、彼らの動きを制限しない方法で提示される

したがって、マイケル・ジャクソンの動きに合わせて、現実のダンサーが動く、というライブ・ショーに重ね合わされた、そのマイケル・ジャクソンのホログラムは拡張現実ではない。このホログラムは現実世界からの入力にはまったく反応しない、本質的に静的な仕掛けだからだ。実際のところ、(ダンサーによって代表される)現実の世界によって、ホログラムは拡張されているが、その逆はないからである。

拡張現実とは、現実世界の拡張であり、現実世界の変化に動的に反応するもののことであって、仮想現実(VR)とは異なる。VRでは、ユーザーは環境から切り離されており、そこで彼らに提示されるのは、完全にシミュレートされた環境であり、その環境を構成する要素のほとんどは虚構のものだ。(SFゲームや人の心臓の巨大モデル内のウォークスルーなどがVRの典型的な事例だ)。しかしながら、仮想現実も、拡張現実も、ユーザーの行動や環境へのインタラクションに、リアルタイムでコンテキストにもとづいた反応をする、という点では同じといえる。

事例

拡張現実という概念は新しいものではない。見過ごされることが多いが、かなり前から広く普及している拡張現実の例に、自動車の駐車支援システムがある。この種のシステムでは、周りの障害からの距離を車両のコンピュータが計算して、ハンドルの位置を基準に、まず、車の軌道を決定する。そのあと、コンピュータはこうした外部からの入力を拡張し、距離が近づくにつれて、強さや周波数が変わる可聴音を出したり、車の障害からの近さや軌道をあらわしたシンボルをバックカメラの動画にオーバーレイしたりするのである。

出典: PriusChat.com

拡張現実システムの例をさらにいくつか挙げたい:

UXにとって拡張現実が重要な理由

拡張現実のインタフェースはコマンドなしのユーザーインタフェースの一例である。コマンドなしのユーザーインタフェースでは、タスクの達成のために利用する情報は、コンピュータシステムがコンテキストに沿って収集したものであり、ユーザーの明示的なコマンドによって集められたものではない。その時点のコンテキストを解釈して、現実を「拡張する」ことができるように、「エージェント」がバックグラウンドで動作し、外部からのさまざまな入力を分析して、それにもとづいて行動を起こしたり、実行可能な情報をユーザーに提供したりしているからである。

たとえば、Waverly Labsの「The Pilot」というイヤホンは能動的に外国語の「聞き取り」をおこない、その言語をリアルタイムで英語(あるいはユーザーの選んだ言語)に翻訳する。ユーザーはそばにいる人が話すたびに聞き取りをするようにイヤホンに指示を出す必要がなく、代わりに、イヤホンの「エージェント」が現実世界の音声入力を常に解釈し続けてくれていて、状況に即して、翻訳を開始してくれるというわけだ。Ingressのようなアプリも、ユーザーがランドマークに近づくやいなや、それに関連した「ポータル」を表示してくれる。駐車支援システムも同様で、ユーザーからの追加の入力やコマンドは必要ない。車両の現況(ギアがバックに入っている)や周辺の障害との相対的な位置にもとづき、すぐに実行可能な情報をシステムが提供してくれるからである。

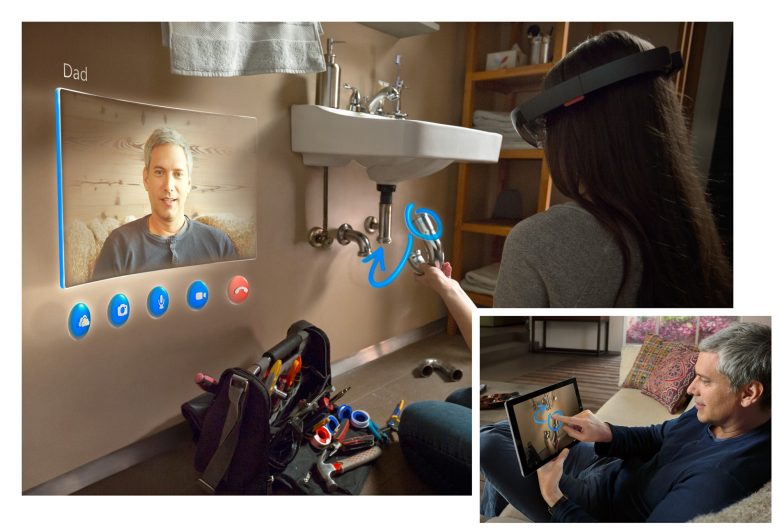

コマンドなしのUIの一種であるARインタフェースは、ユーザーエクスペリエンスを改善するための素晴らしい機会を提供してくれるものである。では、なぜそうなるかを理解するために、飛行機の整備士について考えてみたい。彼女たちは点検のために飛行機の心臓部内をはい回り、特定の部品がどのくらいの期間、利用されてきたかをチェックしなければならないのである。画面ベースの従来のユーザーインタフェースの場合、そうした整備士はその部品の番号を(覚えたり、スマートフォンで写真に撮ったり、紙切れに書き留めたりして)何とかして「セーブ」し、そして、そのあと、スマホやコンピュータベースのシステムにアクセスして、その部品がどのくらいの期間、稼働していたかを判断する必要がある。しかし、HoloLensやGoogle GlassのようなAR技術を使えば、サービス履歴がそのアイテムの真上に表示されるので、ユーザーからのコマンドはまったく、あるいはほとんどいらないだろう。

物理的世界にオーバーレイされた情報のおかげで、部品がはまっている状態のまま、整備士がサービス履歴をチェックできるようになり、外部のデバイスや器具は必要なくなる。また、この操作はあらゆる部品に同じように即座に実行可能なので、飛行機の運行を長く中断させずに、他にも問題がないかどうかを、その問題が悪化したり事故の原因になる前に診断することができるようになるだろう。

こうした(そして、他の多くの)シナリオにおいて、基本的にARは以下の3つの点においてUXを支援することができる:

- タスクを実行するためのインタラクションコストを削減する

事例で取り上げた整備士は、自分のいる環境にとどまったまま、部品のところに表示される関連データを見ることができ、“特に行動を起こす必要がない”。対照的に、非ARのUIでは、整備士は情報にアクセスするために、(もしかしたら必死に)明確な行動を取る必要がある。つまり、彼女は特定のデバイス(携帯電話かコンピュータ)に頼って、それとインタラクトせざるをえないのである。

ARインタフェースではコマンドが必要ないので、インタラクションが効率的になり、ユーザーの労力もほとんどかからない。ARシステムは先回りして積極的に動くので、外部コンテキストからの要求があればいつでも、適切なアクションが取れるのである。 - ユーザーの認知負荷を軽減する

ARシステムがない場合、スマートフォンやデスクトップでの部品の情報の探し方だけでなく、部品番号自体も整備士は覚えておく必要がある(その整備士が番号を書き留めたり、他の形式の外部記憶を利用しない限りは。しかし、こういうふうにしようと思うこと自体がインタラクションコストを増加させることになる)。だが、ARシステムを使えば、部品についての有益な情報が自動的に表示されるので、部品番号をワーキングメモリーに保存したり、それを紙などに「セーブする」のに整備士が労力を費やす必要はない。

したがって、ARのUIはワーキングメモリーへの負荷を以下の2つの点で減少させる:- コマンドなしのあらゆるUI同様、ユーザーがコマンドを覚える必要がない。

- あるコンテキストから別のコンテキストへ、ユーザーが情報をスムーズに移すことができる。

- 複数の情報源を組み合わせて、視線の切り替えを最小限にする

システムが非ARの場合、整備士が部品番号を「セーブ」したあとに、別のシステムを使って、その履歴を見つけたいと思えば、彼女は飛行機から、部品の使用年数の情報を提供してくれる外部情報源に、視線を切り替える必要がある。しかし、ARなら、関連情報がその部品自体の上にオーバーレイ表示されるので、2つの情報源は一元化され、その整備士はあちこち見ないですむようになる。複雑なタスクでは(たとえば、手術や報告書の作成など)、複数の情報源を1つにまとめなければならないことが実に多い。したがって、そうしたタスクの中にはARからメリットを得られるものもあるだろう。

ちなみに、ARインタフェースのこの最後のメリットとは違って、他の2つ(インタラクションコストと認知負荷の削減)は、コマンドのないUIすべてと共通するメリットである。

注意してほしいのは、今回の航空機修理の事例が、“優れたデザイン”のユーザーインタフェースを前提にしていることだ。各部品のそばに表示される「有益な情報」を整備士は見るだろう、と我々は言った。しかし、システムのデザインが良くなければ、多すぎる情報や紛らわしいディスプレイに整備士が圧倒されてしまい、必要な情報を見分けにくくなってしまうだろうことは想像に難くない。いつものことだが、良質なユーザーエクスペリエンスとは、ユーザーのニーズに細心の注意を払うことでしか生まれない。また、新しいUIテクノロジーは、ずさんなデザインをさらに増やすきっかけにもなる。今後、何年間かは質の悪いARシステムが数多く出荷されることになると我々は確信している。しかし、だからこそ、UXの専門家の雇用が長期にわたって確保されるわけで、テクノロジーの変化は我々には関係ないのである。

結論

近年、ARは大成功を収めており、ほとんど労力はかからないのに、現実世界との豊かなユーザーインタラクションをシームレスに提供してくれる場となっている。この成長中のトレンドを活用するテクノロジーが増えるにつれ、今以上に拡張現実の定義が包括的なものになっていくことはありうる。しかし、ユーザーのゴールやコンテキストを理解することにより、効果的でうまくいく拡張現実を、開発者やデザイナーは最終的には作り出すことができるようになるだろう。

記事で述べられている意見・見解は執筆者等のものであり、株式会社イードの公式な立場・方針を示すものではありません。