定量的なユーザー調査手法:概要

製品のユーザーエクスペリエンスについての数値データが必要なのに、何から始めたらよいのかわからない、ということはないだろうか。まず必要なのは正しいツールを選ぶことだ。最もよく使われている定量的手法のリストを確認しよう。

定量的な調査よりも定性的な手法に引き付けられるUXの専門家は多い。そちらのほうが容易で費用がかからないと広く見なされているからである。定量調査につきもののサンプルサイズの大きさや統計学を彼らは敬遠しているのだ。

自分もそうだ、と思うようなら、あなたは損をしている! 定量的な手法は、熟練のUXリサーチャーのツールキットの重要な要素だ。定量的手法は以下のことを可能にしてくれるからである:

- 製品のユーザビリティを数値化する。数字は定性テストの結果や動画よりも(上層部のような人たちを説得しようとしているときには特に)説得力がある場合がある。

- (たとえば、新バージョンと旧バージョン、自社製品と競合他社の製品などの)異なるデザインを比較して、見つけた差異が統計的に有意であり、偶然によるものではないかどうかを判断する。

- UXのトレードオフについての判断をより正確にする。たとえば、提案されたデザイン改善案が実装するにはコストがかかることが予想される場合、そのデザインに変える価値はあるだろうか。その変更によってどれだけユーザビリティが改善されるかを推定するとき、定量的手法はそのデザイン変更をする価値があるかどうかを判断する手助けをしてくれる。

- UXの改善を組織のゴールや主要なパフォーマンス指標に再度関連付ける(それによって、ROIが示され、UXチームの存在が正当化される)。

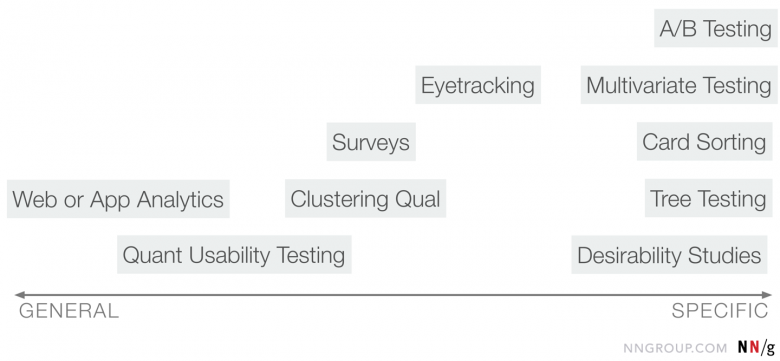

この記事は定量的な調査を始めようとするときに役に立つ。調査実施に向けての第一歩は、UXの定量調査のどの手法が自分たちに必要であるかを判断することだ。今回は、最もよく使われている定量調査の中から以下の手法を紹介する:

- 定量的なユーザビリティテスト(ベンチマーク)

- Webアナリティクス(またはアプリアナリティクス)

- A/Bテストや多変量テスト

- カードソーティング

- ツリーテスト

- アンケート

- 定性コメントのクラスタリング

- デザイラビリティ調査

- アイトラッキングテスト

これらのどの手法も有益な定量データを提供してくれる。しかし、手法によって収集できるデータの種類や必要なリソース、労力は大きく異なる。

この記事では、こうした手法の最も一般的なユースケースを挙げて、各手法のコストと難易度についても判断した。しかし、どんな調査手法もそうであるように、それぞれの手法はさまざまなニーズに合わせて適応させることが可能である。また、コストや難易度は、具体的な状況次第で我々のざっくりとした推定とは変わってくることもありうる。加えて、統計的有意性を判断するのに必要な最小サンプルサイズは手法ごとに異なることも認識しておくべきだろう。

定量的なユーザビリティテスト(ベンチマーク)

- 用途:

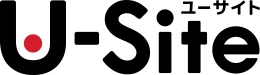

- ユーザビリティの経時的な追跡

- 競合他社との比較

- コスト:中

- データ収集の難易度:中

- 分析の難易度:中

- 手法の種類:行動(ユーザーが何をするか)

- 利用の状況:タスクベース

定量的なユーザビリティテスト(ユーザビリティベンチマークともいう)は、頻繁に使われるわけではないが、定性的なユーザビリティテストによく似ている。ユーザーは、製品を使用して、現実的なタスクを実行するように依頼されるからだ。この2つの主な違いは、定性的なユーザビリティテストでは、ユーザビリティの課題を特定するといった観察が優先されるのに対し、定量的なユーザビリティテストでは、タスク時間や成功率のような指標の収集が重視されることである。

比較的大きなサンプルサイズで(参加者がおよそ35人以上)、こうした指標を収集すれば、その指標を使って、製品のユーザビリティの進捗状況を経時的に追跡したり、ユーザビリティを競合他社の製品と比較したりすることが可能だ。

また、選択するユーザビリティテストのタイプ(対面か、リモート形式のモデレーターありか、リモート形式のモデレーターなしか)に、この手法のコストや難易度は左右される。定量的なユーザビリティ調査と定性的なユーザビリティ調査ではゴールが違うので、テストの構造や使われるタスクも異なるはずだからだ。

基本的な定量的ユーザビリティテストの実施に必要な全スキルについては、我々の1日トレーニングコース、「Measuring User Experience」(ユーザーエクスペリエンスの測定)にて。

Webアナリティクス(またはアプリアナリティクス)

- 用途:

- 問題の検知や優先順位づけ

- パフォーマンスの監視

- コスト:低

- データ収集の難易度:低

- 分析の難易度:高

- 手法の種類:行動(ユーザーが何をするか)

- 利用の状況:自然な状態

アナリティクスデータは、ユーザーが実際の製品を使って何をしているか、つまり、彼らがどこに行き、何をクリックして、どんな機能を利用し、どこから来て、どのページでサイトやアプリから離れることを決めたのかを明らかにする。この情報はUXに関するいろいろな活動に利用できる。とりわけ、製品のさまざまなコンテンツやUI、機能のパフォーマンスをモニターして、何がうまくいっていないのかを特定する役に立つ。

アナリティクスと定量的なユーザビリティテストの違いについての説明は、この2分間の動画を見てほしい。

アナリティクスを特にどうUXに適応させるかについて、さらに詳しくは、我々の1日トレーニングコース、「Analytics and User Experience」(アナリティクスとユーザーエクスペリエンス)にて。

A/Bテストや多変量テスト

- 用途:2つのデザイン案の比較

- コスト:低

- データ収集の難易度:低

- 分析の難易度:低

- 手法の種類:行動(ユーザーが何をするか)

- 利用の状況:自然な状態

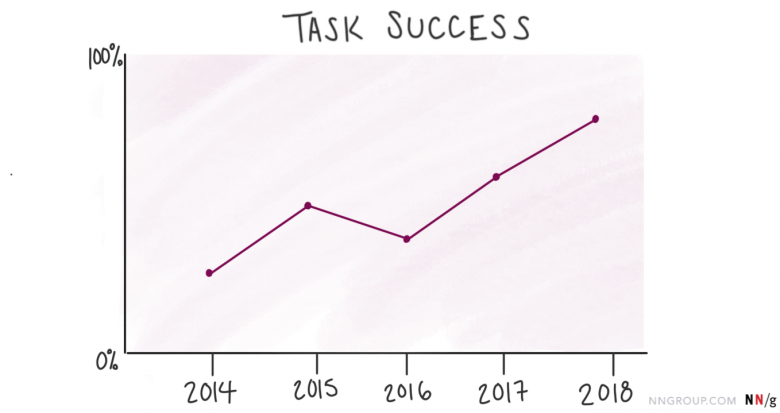

(前述のように)アナリティクス指標を利用すれば、製品のパフォーマンスをモニターできる。一方、A/Bテストや多変量テストを使えば、UIのデザインが変わるとそうした指標がどのように変化するのかを検知する実験も可能だ。

A/Bテストでは、開発チームは、実際に動く2つのバージョンのUIを作成する。そして、それぞれのバージョンを別々のユーザーに見せ、どちらのバージョンのパフォーマンスが最適なのかを確認する。たとえば、同じCTA(call-to-action)ボタンについて、「料金」(Get Pricing)と「さらに詳しくは」(Learn More)という2バージョンのラベルを作成すればよい。そうすれば、この2バージョンのボタンが獲得したクリック数を追跡できるだろう。多変量テストも似ているが、この手法は、複数のデザイン要素を一度にテストする。(たとえば、ページ上にあるいろいろなボタンのラベルやタイポグラフィ、配置をテストすることになる)。

同じデザインの複数のバリエーションから1つを選び出すのに、アナリティクスベースのこの2つの実験は最適だ。その結果、どっちのバージョンのほうがいいのかというチーム内の論争を打ち止めにすることができるだろう。

この手法の大きな欠点はよく誤用されることだ。必要なだけの期間にわたってテストを実施できず、少ない数の結果を元に危険な決断を下してしまうデザインチームもある。

UXのためのA/Bテストと多変量テストについて、さらに詳しくは、我々の1日トレーニングコース、「Analytics and User Experience」(アナリティクスとユーザーエクスペリエンス)にて。

カードソーティング

- 用途:情報アーキテクチャのラベルと構造の判断

- コスト:低

- データ収集の難易度:低

- 分析の難易度:中

- 手法の種類:態度(ユーザーが何を言うか)

- 利用の状況:製品は利用しない

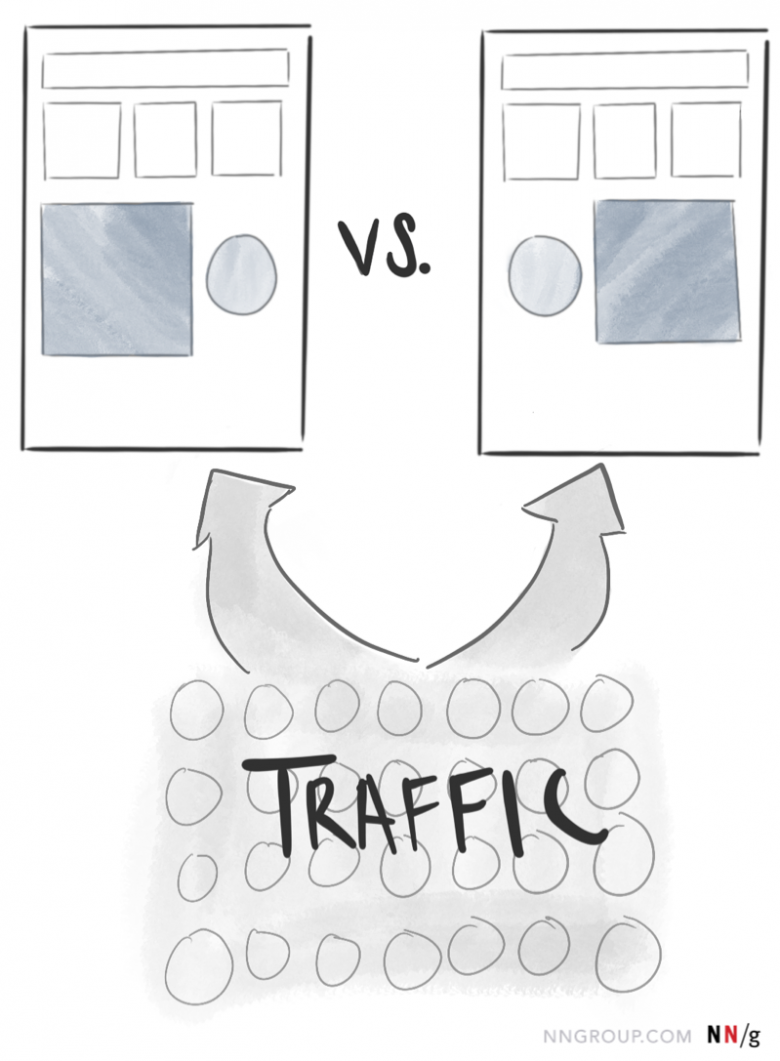

カードソーティング調査では、参加者はコンテンツアイテムを与えられ(文字通り、インデックスカードに書かれていることもある)、そうしたアイテムを自分が理解できるやり方でグループ化し、ラベルを付けるように依頼される。このテストは、対面で物理的なカードを使っておこなうこともできるし、OptimalSortのようなカードソーティングプラットフォームを使ってリモート形式で実施することも可能である。

この手法は、その情報空間についてのユーザーのメンタルモデルに入り込む機会を与えてくれる。彼らはどんな用語を使うのか。また、そうした概念をどのようなロジックでグループ化するか。

似たようなグループを作った参加者の割合を定量的に分析すれば、最も多くのユーザーに理解してもらえるカテゴリー化の方法を確立できるだろう。

ツリーテスト

- 用途:情報アーキテクチャの階層の評価

- コスト:低

- データ収集の難易度:低

- 分析の難易度:中

- 手法の種類:行動(ユーザーが何をするか)

- 利用の状況:タスクベース、製品は利用しない

ツリーテストは、参加者がサイトのカテゴリー構造のみを使って、タスクの達成を試みるというものだ。この手法は、基本的には、情報アーキテクチャを評価するための手法で、情報アーキテクチャをUIの他のすべての側面から分離する方法でおこなわれる。

たとえば、ペット用品のWebサイトであると想定しよう。そして、そのトップレベルの階層は次のようになっているとする。

タスクでは、犬用の首輪を見つけてほしいと参加者に依頼すればよい。ツリーテストの結果を定量的に分析すれば、このサイトの情報階層の中でユーザーが正しい経路を見つけられたかどうかがわかる。間違った経路を選んだ参加者が何人いたのか、ということだ。

この手法は、IAの構造やラベル、配置がユーザーの期待と一致しているかどうかを確認する役に立つ。

情報アーキテクチャのデザインや評価方法についてのさらに詳しい情報は、我々の1日トレーニングコース、「Information Architecture」(情報アーキテクチャ)にて。

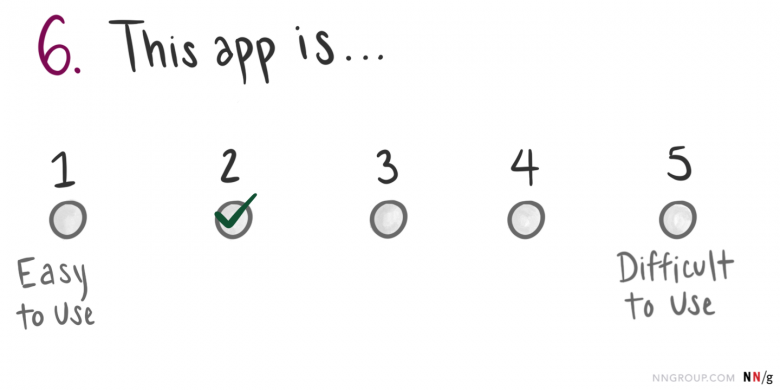

アンケート

- 用途:ユーザーや彼らの態度、行動に関する情報収集

- コスト:低

- データ収集の難易度:低

- 分析の難易度:低

- 手法の種類:態度(ユーザーが何を言うか)

- 利用の状況:すべて

アンケートは柔軟性のあるユーザー調査ツールだ。さまざまな状況において実施可能だからだ。実際のWebサイトやEメールの中、あるいはユーザビリティテストの終了後などに、短時間のインターセプト調査としておこなうことができるからである。

この手法では、レーティングや多肢選択式の問題での各選択肢に対する回答率のような定量データと、自由記述の回答のような定性データを組み合わせることが可能だ。さらには、アンケートへの定性的な回答を数値データに変換することもできる。(定性的なコメントのコーディングについては次のセクションを参照してほしい)。

自分たち専用のオリジナルのアンケートを作ってもよいし、定評のあるアンケート(たとえば、システムユーザビリティスケールやネットプロモータースコアなど)の1つを利用することも可能だ。こうしたアンケートの1つを使うことのメリットは、結果を業界や競合他社のスコアと比較して、自分たちの状況を確認できる場合が多いことだ。しかし、アンケートをオリジナルで作ったとしても、自分たちの平均スコアを経時的に追跡すれば、製品の改善状況をモニターしていくことは可能である。

アンケートのデザインやさまざまな定性的ユーザー調査手法について、さらに詳しくは、我々の1日トレーニングコース、「User Research Methods: From Strategy to Requirements to Design」(ユーザー調査手法:戦略から要件、デザインまで)にて。

定性データのクラスタリング

- 用途:定性データ内の重要なテーマの特定

- コスト:低

- データ収集の難易度:中

- 分析の難易度:中

- 手法の種類:態度(ユーザーが何を言うか)

- 利用の状況:すべて

この手法は、データ収集方法というよりは、定性データの解析法であるといえる。共通のテーマに基づいた定性的な調査(たとえば、日記調査やアンケート、フォーカスグループ、インタビューなど)からの観察結果を分類するものだからだ。観察結果が大量にある場合は、特定のテーマについての言及があった事例を数えてもよい。

たとえば、製品が使われる状況を知ることを目的に、1週間、参加者が日常生活の中で製品を使うたびに報告をしてもらうという日記調査を実施したとする。この場合は、参加者が職場や自宅、あるいは外出中に製品を使った回数を数えればよい。

この手法によって、たとえば、ユーザーの苦情やUIの問題の頻度などの、特定のテーマや状況の発生率や頻度を確認することが可能だ。

このやり方は、大量の定性的な情報から数値データを引き出すには効果的である。しかし、多大な時間が必要になることもあるだろう。

デザイラビリティ調査

- 用途:製品やブランドに関連する属性の特定

- コスト:低

- データ収集の難易度:低

- 分析の難易度:低

- 手法の種類:態度(ユーザーが何を言うか)

- 利用の状況:タスクベース

定量的なデザイラビリティ調査は、見た目の美しさやブランド競争力、口調のような、製品の質を定量化して測定しようとするものだ。この調査は、調査課題に合わせてカスタマイズ可能だが、一般には、(静止画を見せるにしろ、実際の製品やプロトタイプを使ってもらうにしろ)その製品に初めて触れる参加者によっておこなわれる必要がある。そして、デザインを説明する単語のリストから当てはまるものを選び出すことで、彼らにそのデザインを説明してもらう。母集団を代表できる大きなサンプルサイズであれば、傾向が見えてくる。たとえば、参加者の84%がデザインを「斬新」と説明するのなら、そのデザインにはそういう傾向があるということだ。

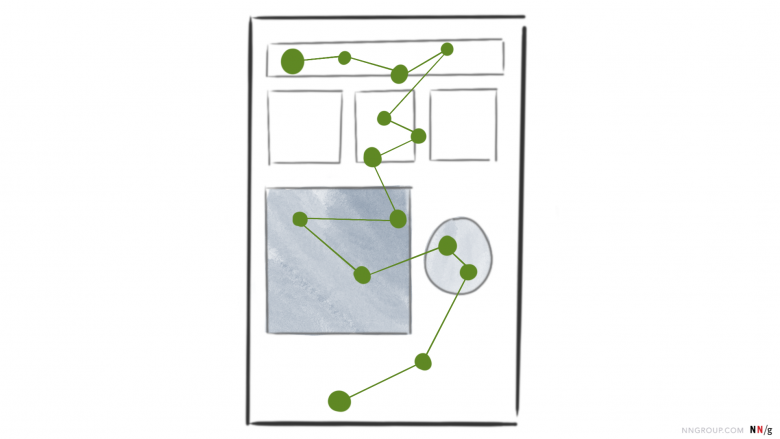

アイトラッキングテスト

- 用途:どのUI要素が気をそらしたり、見つけやすかったり、発見しやすいかの判断。

- コスト:高

- データ収集の難易度:高

- 分析の難易度:高

- 手法の種類:行動(ユーザーが何をするか)

- 利用の状況:タスクベース

アイトラッキング調査は、インタフェース上を移動するユーザーの目を追跡する専用機器を必要とする。多数の参加者(30人以上)が同じインタフェース上で同じタスクを実行すれば、意味のある傾向が見えてくるので、ページのどの要素がユーザーの目につくのかについて信頼性のある情報が得られるというわけだ。アイトラッキングをおこなえば、ユーザーがゴールを達成できるようにするには、インタフェースやコンテンツのどの要素を目立たせる、あるいは目立たないようにする必要があるかを特定できる。

しかし、アイトラッキング調査では、非常に専門的で、ひどく高価な上にやや不安定で、利用するにはたくさんのトレーニングを必要とする装置が、実施の大きな障害となるだろう。

アイトラッキング調査の実施を検討中なら、我々の無料レポート、『How to Conduct Eyetracking Studies』(アイトラッキング調査の実施方法)をチェックしてほしい。

手法の選択

| 手法 | 典型的な用途 | コスト | データ収集の難易度 | 分析の難易度 | 種類 | 利用の状況 |

|---|---|---|---|---|---|---|

| 定量的なユーザビリティテスト | ユーザビリティの経時的な追跡競合他社との比較 | 中 | 中 | 中 | 行動 | タスクベース |

| Webアナリティクス(または アプリアナリティクス) | 問題の検知や優先順位づけパフォーマンスの監視 | 低 | 低 | 高 | 行動 | 自然な状態 |

| A/Bテスト | 具体的な2つのデザイン案の比較 | 低 | 低 | 低 | 行動 | 自然な状態 |

| カードソーティング | 情報アーキテクチャのラベルと構造の判断 | 低 | 低 | 中 | 態度 | 製品は利用しない |

| ツリーテスト | IAの階層の評価 | 低 | 低 | 中 | 行動 | 製品は利用しない |

| アンケート | ユーザーや彼らの態度、行動に関する情報収集 | 低 | 低 | 低 | 態度 | すべて |

| 定性コメントのクラスタリング | 定性データ内の重要なテーマの特定 | 低 | 中 | 中 | 態度 | すべて |

| デザイラビリティ調査 | 製品やブランドに関連する属性の特定 | 低 | 低 | 低 | 態度 | タスクベース |

| アイトラッキングテスト | どのUI要素が気をそらしたり、見つけやすかったり、発見しやすいかの判断 | 高 | 高 | 高 | 行動 | タスクベース |

この表は、ここまで論じてきた手法についてまとめたものである。

調査課題の検討から始めよう

どの定量手法を利用すべきかを判断しようとするときには、調査の課題について考えるところから始めるとよい。何を知る必要があるのか、ということだ。今回の手法のうちのいくつかは、以下のような、非常に一般的な調査課題に最も適している:

- 自分たちの製品のユーザビリティがどのように経時的に変化したか。

- 競争相手に比べて自分たちの状況はどうか。

- 自分たちの問題のどれが最も影響が大きいか。どのように優先順位づけをすべきか。

この種の課題には、定量的なユーザビリティテストやWebアナリティクス、アンケートを利用することになるだろう。

そして、以下のような、より具体的な課題について答えがほしい場合には、上記以外の手法がうまくいく:

- グローバルナビゲーションのカテゴリーをどのように改善すべきか。

- 自分たちのビジュアルデザインについて、大半のユーザーはどう思っているのだろうか。

- ダッシュボードのデザインには、この2つの案のどちらを使うべきか。

こうした調査課題には、おそらく、A/Bテストやカードソーティング、ツリーテスト、定性的なコメントへのコーディング、デザイラビリティ調査、アイトラッキングを利用する必要があるだろう。

しかしながら、上記のアドバイスにはグレーゾーンもある。たとえば、あなた方の会社では、セキュリティや技術的な理由から、A/Bテストが選択肢に入らないかもしれない。そうした場合は、その予算があるなら、対面の定量的なユーザビリティ調査をおこない、2つのプロトタイプを比較すればよい。しかしながら、これは定量的なユーザビリティテストの利用方法としては一般的ではないので、ここでは論じなかった。

コストを検討しよう

手法の選択をするのに、調査課題についで2番目に影響が大きいのがコストだ。今回挙げた手法は、調査の実施の仕方によって大きくコストが変わってくる。利用するツールや集める参加者の数、リサーチャーが費やす時間のどれもが、最終的なコストに影響するからだ。さらにややこしいのは、チームによって調査予算が大きく異なることだ。繰り返すが、ここでのコストの見積もりは相対的なものである。

予算があまりないチームは、リモート式のユーザビリティテストやOptimalSortのようなオンラインカードソーティングのプラットフォーム、A/Bテスト、Webやアプリのアナリティクスといった、デジタル手法に依存することになるだろう。経験からいって、(対面のユーザビリティテストや対面のカードソーティングのような)対面でおこなう手法のほうが費用はかかることが多い。リサーチャーの時間が大量に必要になるからだ。さらに、そうした手法は移動や機器のレンタルが必要なこともある。今回挙げた手法の中で最も費用がかかるのはアイトラッキングだ。そのため、大きな予算と、この手法を利用するに値する調査課題のあるチームのみが利用するといいだろう。

次のステップ

手法を選択したら、それについて学ぼう! しっかりこの宿題をこなし、自分のやりたいように調査を計画し、実施できるように、そして、必ず有益な結果を得られるようにしよう。記事の最後にある「資料」セクション以外にも、この記事では、いたるところにリンクを入れて、各手法の参考になる資料をさらに示した。

注意:統計的な分析を何もしないで、ただ指標を集めて、判断することはしてはならない。単に5人のユーザーから評価尺度についての回答を集めて、平均を取ったら、次にいく、というのでは不十分だからだ。

今回論じた各手法には、それぞれ異なった推奨される最小サンプルサイズ(信頼できるデータを集めて、統計的有意性を判断するために集める必要があるデータポイントの数)がある。この最小サンプルサイズは達成しなければならない。そうでないと、調査結果が単なる偶然ではないという保証が得られないからだ。

選んだ手法が何であれ、それに関連する統計的概念を調べるために必要な時間と、正確な最小サンプルサイズを獲得するためのコストは、必ず考慮に入れておいてほしい。見た目ほどは大変ではないし、定量的なデータというのは、それだけの手間をかける価値が十分にあるということは約束しよう。

資料

Measuring UX and ROI (Full-day course)

“統計的有意性の理解”(記事)

“What Does Statistically Significant Mean?” (Article)

“How to Compute a Confidence Interval in 5 Easy Steps” (Article)

“ユーザビリティの投資対効果”(記事)

Return on Investment (ROI) for Usability, 4th Edition (Report)

“ユーザーエクスペリエンス調査、どの手法をいつ使うべきか”(記事)

“UX Research Cheat Sheet” (Article)

Measuring U’s sample size and confidence interval calculators (Tool)

定量的なユーザビリティテスト(ベンチマーク)

“定量的ユーザビリティテストと定性的ユーザビリティテスト”(記事)

“Remote Usability Tests: Moderated and Unmoderated” (Article)

“Remote Moderated Usability Tests: How and Why to Do Them” (Article)

アナリティクス

Analytics and User Experience (Full-day course)

“Analytics vs. Quantitative Usability Testing” (Video)

“ユーザーエクスペリエンス実践における、アクセス解析の3用途”(記事)

“Five Essential Analytics Reports for UX Strategists” (Article)

A/Bテストや多変量テスト

Analytics and User Experience (Full-day course)

“A/Bテストの位置づけ”(記事)

“Define Stronger A/B Test Variations Through UX Research” (Article)

“10 Things to Know About A/B Testing” (Article)

“Multivariate vs. A/B Testing: Incremental vs. Radical Changes” (Article)

カードソーティング

Information Architecture (Full-day course)

“カードソーティング: より良い情報アーキテクチャのために、ユーザーのメンタルモデルを明らかにしよう”(記事)

“カードソーティング: ユーザーに言葉合わせを乗り越えさせる”(記事)

“Card Sorting: How to Best Organize Product Offerings” (Video)

“How to Avoid Bias in Card Sorting” (Video)

ツリーテスト

Information Architecture (Full-day course)

“Tree Testing: Fast, Iterative Evaluation of Menu Labels and Categories” (Article)

“Tree Testing Part 2: Interpreting the Results” (Article)

“Using Tree-Testing to Test Information Architecture” (Article)

アンケート

User Research Methods: From Strategy to Requirements to Design (Full-day course)

“12 Tips for Writing Better Survey Questions”(Article)

“Cleaning Data from Surveys and Online Research” (Article)

定性コメントのクラスタリング

“5 Examples of Quantifying Qualitative Data” (Article)

“How to Code and Analyze Verbatim Comments” (Article)

“Diary Studies: Understanding Long-Term User Behavior and Experiences” (Article)

デザイラビリティ調査

“Desirability Studies: Measuring Aesthetic Response to Visual Design” (Article)

“Using the Microsoft Desirability Toolkit to Test Visual Appeal” (Article)

“Microsoft Desirability Toolkit Product Reaction Words” (Article)

アイトラッキングテスト

How to Conduct Eyetracking Studies (Free report)

“Eyetracking Shows How Task Scenarios Influence Where People Look” (Video)

記事で述べられている意見・見解は執筆者等のものであり、株式会社イードの公式な立場・方針を示すものではありません。